انواع برچسب اشتباه (noisy label) در داده ها

فهرست مطالب

Toggleدرحالی که شبکه های یادگیری عمیق و الگوریتم های یادگیری ماشین امروزه توانسته اند به خوبی از پس مسائل برآیند اما با حجیم تر شدن داده ها کیفیت داده ها و برچسب های داده نیز مهم تر از قبل شده اند چون کیفیت داده ها و برچسب های آن با دقت وکارایی مدل رابطه مستقیم دارند.در این مقاله قصد داریم انواع نویز در برچسب ها(labels) یا برچسب های نویزی و دلایل ایجاد آن را بررسی کنیم. اینکه داده نویزدار یا داده های نویزی چیست؟

شما میتوانید بسیاری از دیتاست های آماده را از منابع متن باز دانلود کنید.

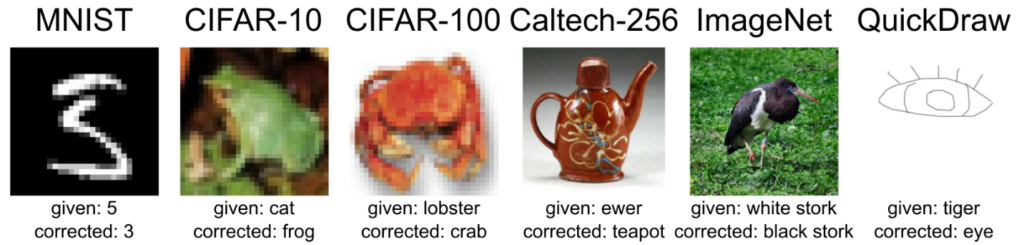

همانطور که در تصویر زیر میبینیم در دیتاست های معرف برچسب گذاران (labelers) به دلایلی که در ادامه گفته میشود اشتباه برچسب گذاری کردند به عنوان مثال در دیتاست CIFAR-10 تصویر یک قورباغه(frog) به اشتباه گربه(cat) برچسب گذاری شده است.

برچسب گذاری یا برچسبزنی (Labeling) در یادگیری ماشین چیست؟

فرآیندی است که در آن برچسبها یا برچسبهای هدف به دادهها اختصاص داده میشوند. برچسبها معمولاً به عنوان پاسخهای مورد انتظار یا خروجیهای مدل یادگیری ماشین عمل میکنند. به عبارت دیگر، برچسبها به مدل یادگیری ماشین میگویند که هر داده در دسته یا دستهبندی خاصی قرار دارد.

برچسب گذاری دادهها یک مرحله مهم در یادگیری ماشین است زیرا دادههای برچسبدار به مدل یادگیری ماشین کمک میکنند تا الگوریتمهای یادگیری خودکار براساس نمونههای قبلی پیشبینی کنند. از این رو، برچسب گذاری دادهها به مدلهای یادگیری ماشین اجازه میدهد تا الگوها و ارتباطات موجود در دادهها را درک کرده و پیشبینیهای دقیقتری ارائه دهند.

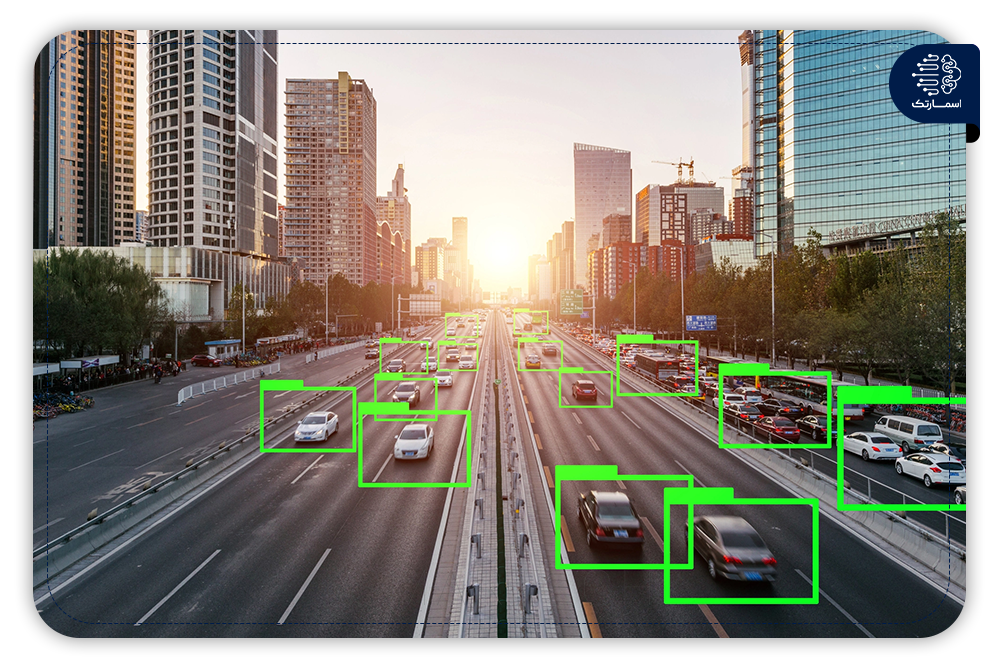

برای مثال، در یادگیری ماشین برای تشخیص تصاویر، برچسبها میتوانند شامل نوع اشیا، افراد، حیوانات و غیره باشند. در یادگیری ماشین برای پیشبینی قیمت خانهها، برچسبها میتوانند شامل قیمتهای واقعی خانهها باشند.

برچسب گذاری درست دادهها در یادگیری ماشین به چندین دلیل مهم است:

آموزش مدلهای یادگیری ماشین

برچسب گذاری دادهها به مدلهای یادگیری ماشین اجازه میدهد تا الگوها و ارتباطات موجود در دادهها را درک کرده و با استفاده از آنها، پیشبینیهای دقیقتری انجام دهد. با داشتن برچسبهای صحیح، مدلهای یادگیری ماشین میتوانند با استفاده از دادههای برچسبدار آموزش ببینند و بهبود یابند.

ارزیابی عملکرد مدلها

برچسب گذاری دادهها به ما امکان میدهد تا عملکرد مدلهای یادگیری ماشین را ارزیابی کنیم. با داشتن برچسبهای واقعی، میتوانیم پیشبینیهای مدل را با واقعیت مقایسه کرده و میزان دقت و کارایی مدلها را ارزیابی کنیم.

سازماندهی دادهها

برچسب گذاری دادهها به ما امکان میدهد تا دادهها را بر اساس دستهبندیهای مختلف سازماندهی کنیم. این امر میتواند در مواردی مانند دستهبندی محصولات، تحلیل علمی، پردازش زبان طبیعی و سایر برنامههای کاربردی دیگر مفید باشد.

جمعآوری و تهیه دادههای برچسبدار

برچسب گذاری دادهها میتواند مرحله اولیه جمعآوری و تهیه دادههای برچسبدار برای آموزش و ارزیابی مدلهای یادگیری ماشین باشد.

دلایل انواع برچسب اشتباه (noisy label)

هنگام برچسب گذاری داده ها امکان وجود اشتباه توسط برچسب گذاران وجود دارد که مرسوم ترین اشتباهات می توان به موارد زیر اشاره کرد.

برچسب گذاری جمعی

به علت اینکه حجم زیادی از داده ها را نیازداریم برچسب گذاری های زیادی نیز انجام میدهیم برای اینکار تعدادی از موسسه ها و سایت هایی وجود دارند و افرادی به عنوان برچسب گذار استخدام میشوند که وظیفه برچسب گذاری داده ها را به عهده دارند. برچسب گذارانی که استخدام میشوند بابت هر برچسبی که به داده ها میدهند هزینه ایی دریافت می کنند و آنها معمولا سعی میکنند در کمترین زمان بیشترین برپچسب گذاری را انجام دهند تا حقوق بیشتری دریافت کنند.

یکی از پلتفرم هایی که با کمک افراد از سراسر دنیا برچسب گذاری جمعی انجام میدهد و بابت آن حقوق پرداخت میکند سرویس mechanic turk amozon می باشد

برچسب گذاری یک مهارت است

گاهی اوقات برچسب گذاری یک مهارت میشود به عنوان مثال یک پزشک میخواهد تصویر یک چشم و بیماری مرتبط با آن را برچسب گذاری کند که در این صورت باید دارای اطلاعات زیادی را درمورد بیماری های چشم داشته باشد در غیر این صورت اشتباه برچسب گذاری می کند.

داده های خراب یا noisy label

یکی دیگر از علل اشتباه گذاری برچسب ها این است که داده ها خراب هستند و مشکل دارند به عنوان مثال تصویری که میخواهد برچسب گذاری شود به علت کیفیت بد، برچسب گذار نمی تواند تشخیص دهد که دقیقا تصویر را با چه کلاسی برچسب گذاری کند.

یکی از نقاط ضعف چت بات Chat GPT که موجب تولید پاسخ اشتباه می شود همین موضوع هست.

انواع نویز در برچسب ها

نویز در برچسب ها شامل چهار دسته می شود که به توضیحات هر یک می پردازیم.

نویز متقارن

نویز متقارن ساده ترین نوع نویزدر برچسب ها می باشد این نویز بدین صورت تعریف میشود که اگر برچسب یک کلاسی بخواهد عوض شود شانس برابری با بقیه کلاس های دیگرمجموعه دارد که در این صورت ماتریس انتقال[1] برای بقیه کلاس ها برابر می شود.

نویز نامتقارن

این نوع نویز نیز به این صورت تعریف میشود که اگر بخواهیم برچسب کلاسی رو عوض کنیم یک کلاس دیگر بیشتر شانس را برای برچسب گذاری دارد.

نویز معنایی

این نوع نویز سخت ترین نوع نویز می باشد و مدل به سختی با این نوع نویز تطبیق می یابد که در ماتریس انتقال آن وقتی بخواهیم برچسب را بین کلاس های مختلف برگردانیم هر کلاس شانس متفاوتی دارد.

نویز مجموعه باز

گاهی اوقات در مجوعه داده هایمان یک کلاسی اضافه برکلاس های تعریف شده می ببنیم به عنوان مثال هنگامی که در گوگل چیزی را سرچ می کنیم اطلاعاتی که اضافه نشان میدهد از نوع نویز مجموعه باز می باشد.

جمع بندی

همانطور که می دانیم هوش مصنوعی توانسته است مسائل مهم حوزه های مهندسی و غیرمهندسی را به شیوه ی نوین و بسیار با کارایی بهتر حل کند. اگر شما به دنبال کسب درآمد از هوش مصنوعی هستید باید بدانید که یکی از رکن های اساسی برای حل مسائل داشتن داده های تمیز ودرست میباشد اما با امروزه با حجم عظیم داده ها و راه های مختلف گردآوری داده ها در هر مجموعه ای داده ای امکان وجود داده های نادرست نیز هست یکی از شیوه هایی که امکان دارد این داده ها اشتباه باشند وجود برچسب های اشتباه می باشد که این برچسب های نویزی باعث می شود از کارایی دقت مدل کاسته شود و کارایی مدل را هنگام مواجه با نمونه های جدید را کاهش دهد با اگاهی از انواع برچسب های اشتباه میتوانیم از اثرات جانبی آن جلوگیری کنیم.

منابع

[1] | Scott E, Reed & Honglak Lee, Dragomir Anguelov, Christian Szegedy, Dumitru Erhan & Andrew Rabinovich, “TRAINING DEEP NEURAL NETWORKS ON NOISY LABELS WITH BOOTSTRAPPING,” ICLR, pp. 50-62, 2015. |

[2] | |

[3] | Youngdong Kim, Junho Yim, Juseung Yun, Junmo Kim, “NLNL: Negative Learning for Noisy Labels,” computer vision foundaion, pp. 66-72, 2018. |

[4] | Hongyi Zhang, Moustapha Cisse, Yann N. Dauphin, David Lopez-Paz, “mixup: BEYOND EMPIRICAL RISK MINIMIZATION,” conference paper at ICLR, pp. 22-26, 2018. |

[5] | Aritra Ghosh, Himanshu Kumar, P. S. Sastry, “Robust Loss Functions under Label Noise for Deep Neural Networks,” Thirty-First AAAI Conference on Artificial Intelligence, pp. 110-114, 2015. |

علی عطائی فر

فارق التحصیل از هنرستان هوانوردی مجمع صنعت

فارق التحصیل کاردانی از دانشگاه هواپیما ساها در رشته اویونیک

دیدگاهتان را بنویسید